CMOS传感器

CMOS选型基础

本篇笔记介绍 CMOS 图像传感器涉及的基础知识,分为基本概念、工作原理、内部结构、性能指标、相关技术、补充知识几个部分。

一、基本概念

图像传感器

图像传感器是图像采集设备中的核心部件,常见的通用图像传感器有 CCD 图像传感器和 CMOS 图像传感器。此外还有 SWIR 图像传感器(短波红外图像传感器)、UV 图像传感器(紫外图像传感器)、偏光图像传感器、多光谱图像传感器、热敏图像传感器、3D-ToF 图像传感器等专用图像传感器。

- CCD:Charge-Coupled Device,电荷耦合元件,电荷信号先传送,后放大,再 AD,成像质量灵敏度高、分辨率好、噪声小;处理速度慢,功耗高,造价高,工艺复杂。每个像素点有一个光电二极管,在整个传感器的边缘或输出端设置一个或少数几个公共放大器。所有像素共享同一个电荷-电压转换器,所以像素一致性好。

- CMOS:互补金属氧化物半导体,电荷信号先放大,后 AD,再传送;成像质量灵敏度低、噪声明显;处理速度快,功耗低,造价低,工艺简单。每个像素点上都有自己的光电转换器和放大器。每个像素都有自己专用的电荷-电压转换器,一致性很不容易控制。

CMOS 传感器简称 CIS(CMOS Image Sensor)(以下均称 CIS),采用与大多数微处理器和存储器芯片相同的材料和技术制造,容易制造并且最具成本效益。CIS 的本质是自带像素结构的相机芯片,每个像素进行自己的电荷转换,从而显著减少产生图像所需要的能量和支持电路。CMOS 的性能不断提升,使其在手机摄影、安防、车载系统等领域逐渐超越 CCD 传感器。目前消费级市场中 CMOS 几乎完全取代了 CCD,CCD 一般只在医疗、天文以及特定的科研领域使用。

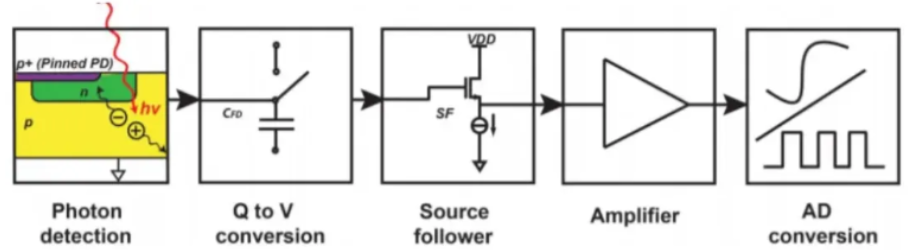

CIS 的主要功能包括光信号转换为电信号、电信号的放大去噪等处理、电信号转换为数字信号、数字信号处理(如 BLC、DPC 等),数据输出。

数字图像形成过程

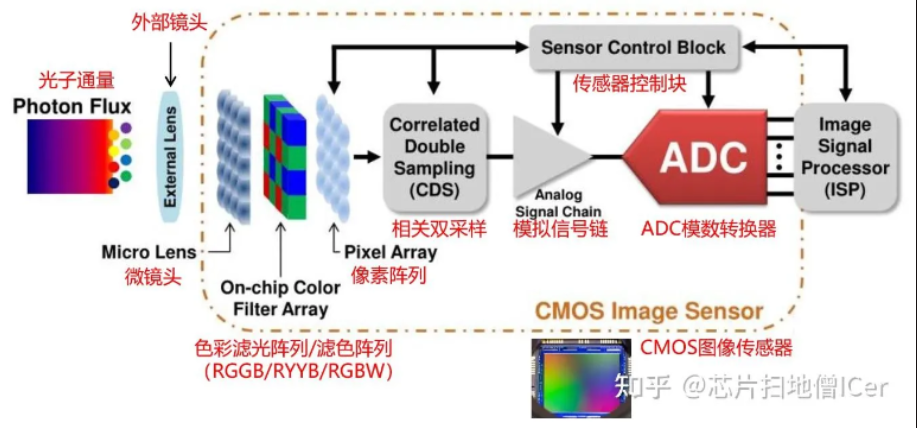

相机的镜头将三维世界中的物体反射或自身发出的光线汇聚到相机的感光芯片上;感光芯片将汇聚的环境光转换成数字信号,即像素,从而形成图像,即曝光。在按下快门的一刻,外界光线(Photon Flux)会穿过镜片组(External Lens + Micro Lens)聚集;经过 color filter 滤波后打到感光元件上,其内部将光信号转为像素阵列的形式,并经 ADC 转成数字信号,最后交由图像处理器(ISP,Image Signal Processor)处理成一张数码照片。

二、工作原理

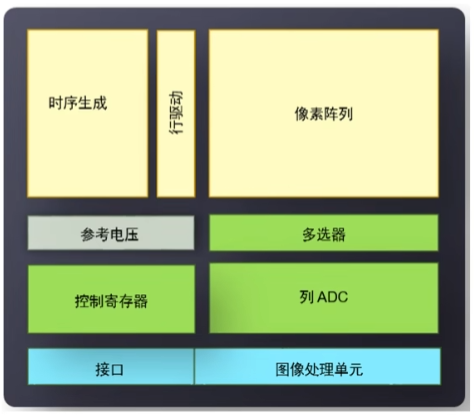

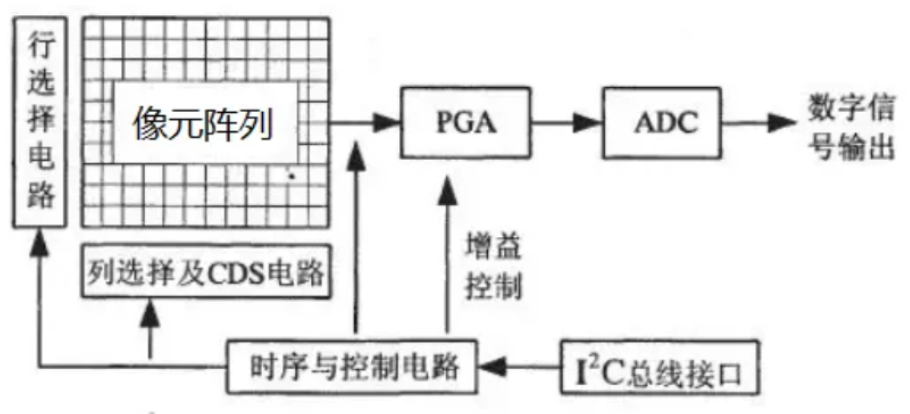

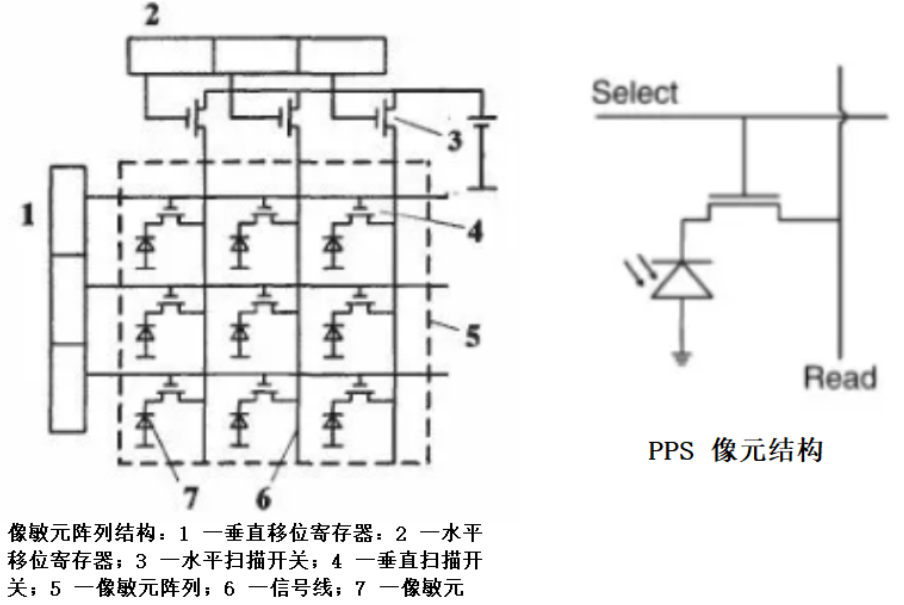

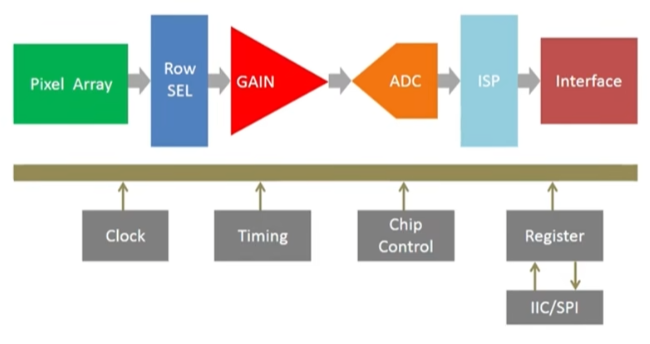

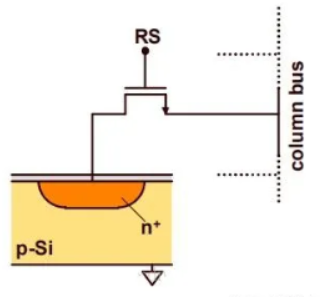

CIS 的电路由像敏单元阵列、行驱动器、列驱动器、时序控制逻辑、增益控制器(PGA,可编程增益放大器)、AD 转换器、数据总线输出接口、控制接口几部分集成在同一块硅片构成。有的芯片还集成了其它数字信号处理电路以进行后续的 ISP 处理。像敏元阵列和像元结构(以 PPS 为例,PPS 是无源像素被动式传感器,是一种像元结构)如图。

CIS 的工作流程分为复位、光电转换、光积分、读出四个步骤。

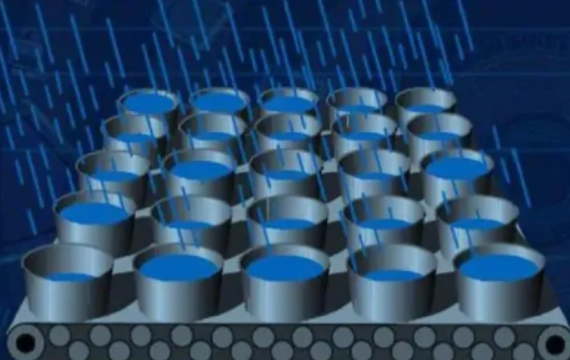

外界光照射像素阵列,通过光电效应激发出电子,在像素单元内产生相应的电荷,被像点下方的势阱捕获并存储起来(势阱指像点下方的电场),完成光电转换。像点曝光的过程,非常类似于用很多小桶接雨水的过程。当收集到合适数量的雨水后,会有专门的工序统计每一个水桶收集到多少雨水,然后将桶倒空,重新开始下一次收集。如果入射的光子太少则可能什么都记录不到,如果入射的光子太多则只能记录其所能容纳的最大值,多余的光电子由于无处安置只能就地释放,就像水桶盛满之后再继续接水就会溢出一样。溢出的自由电子会被专门的机制捕获并排空。

光积分期间,MOS 管截止,光敏二极管随入射光的强弱产生对应的载流子并存储在源极的 PN 结上。当积分期结束时,水平移位寄存器和垂直移位寄存器分别对列和行进行寻址,产生扫描脉冲,使被选中的 MOS 管栅极导通,给像元的光敏二极管加上偏压。被光照的光敏二极管产生载流子使结电容放电复位到参考电位,并引起与入射光强对应的负载电流。信号读出过程与光积分过程类似,通过寻址将图像信号传输到 CVC(电荷/电压放大器,将像元势阱中电荷数量转化为电压信号)和 AD 转换器,最终转换成数字图像信号输出。图像信号幅值大小正比于该像元上的光照强弱。

像点记录光信号以及信号读出的原理和计算机内存的工作原理非常相似。CIS 会使用一个行选信号(Row Select)和一个列选信号(Column Select)来选中一个存储单元(Pixel),被选中的存储单元与输出放大器联通,将其存储的电荷数转换成电压值输出到阵列外部。(之所以叫像点而不叫像素是因为,一个严格意义上的像素是具备红、绿、蓝三个颜色分量的组合体,能够表达 RGB 空间中的一个点。而 CIS 上的一个像点只能表达三种颜色中的一个,所以在 CIS 范畴内并不存在严格意义上的像素概念。但是很多情况下人们并不刻意区分像素和像点在概念上的差别,经常会用像素来指代像点,一般也不会引起歧义。)

注 1:CIS 功能框图中提到的 CDS 是指双相关采样技术,在后文相关技术的噪声处理部分讲解。

注 2:CIS 中用来控制曝光长短的寄存器参数称为积分时间(integration time,后面简称 int_t),一般以行为单位。曝光时间和积分时间存在确定的换算关系。比如 int_t=159,指的是 reset 信号和 read 信号之间的间隔为 159 行,而每行所占的绝对时间(line_time)与 CIS 主频(pixel clock,PCLK)和每一行包含多少像素(h_size 行长,以 PCLK 数为单位,1/PCLK 为一个时钟周期,即扫描一个像素需要花费的绝对时间)有关,具体公式为 line_time=h_size / pclk,曝光时间即为所有行的时间之和,因此曝光时间与积分时间的换算公式如下:exposure time = int_t * line_time

三、内部结构

CIS 模块框图

像素结构

像素(Pixel)是图像传感器的最小感光单元,像素阵列排列在一起形成了图像传感器的感光区域。

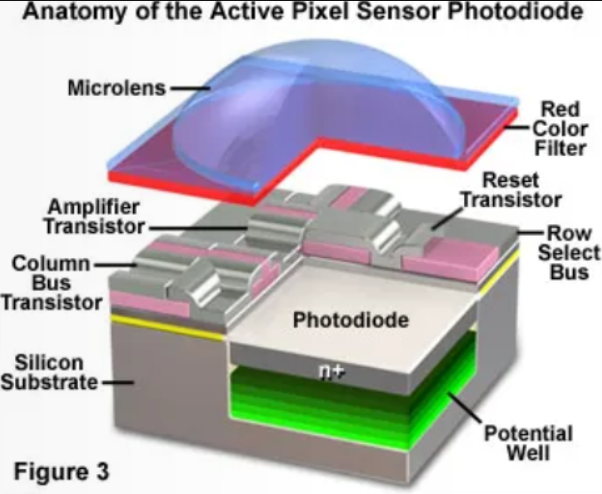

CIS 中一个像素点由五部分组成

- 硅感光区,捕获光子,激发光生电子

- 势阱,用电场捕获、存储光生电子

- 电路,将电荷数量变换为电压信号,以及复位、选择、读出逻辑

- 滤光膜,选择性透过三种波长中的一种,用于感知颜色

- 微透镜,将入射光线会聚到感光区(随着像素内电路数量的不断增加,留给感光二极管的空间逐渐减少,为了避免这个比例的下降,使用微透镜来改变入射光线的方向,使得本来会落到连接点或晶体管上的光线重回到对光敏感的二极管区域)

像素类型/像素技术

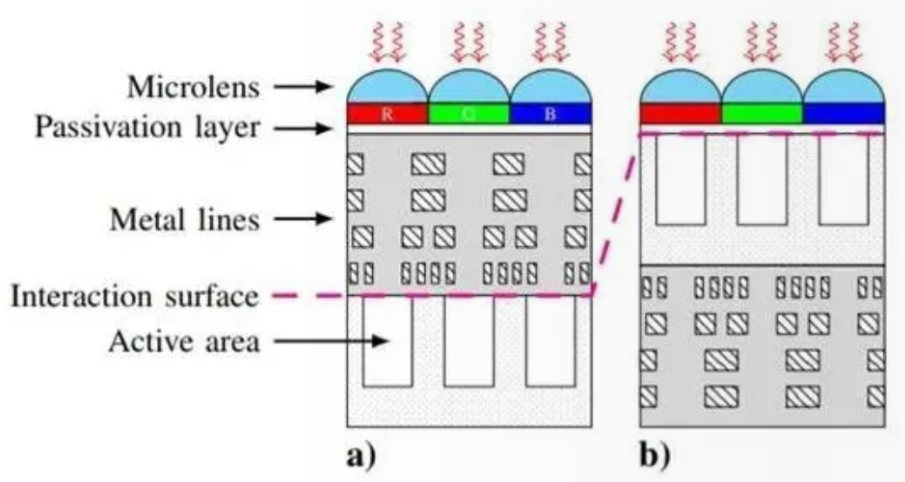

主要分为 FSI(前照式,左图)和 BSI(背照式,右图)两种。在 BSI 基础上的改良还有 Stack(堆栈式)和 Quad Bayer 阵列(四合一像素技术)。

前照式的金属布线层在 CFA 和光电二极管的中间,光线从金属控制线之间进入,到达光敏二极管时会有损失,背照式则将金属布线层放在了光电二极管的下面,光线透过彩色滤波片后可直接进入到光电二极管,不仅增大了进光量,且有效抑制了光线射入角变化引起的感光度下降,在低照条件下的成像亮度和清晰度都比 FSI 有更大的优势。如今,背照式已成为中高端 CIS 的主流技术。

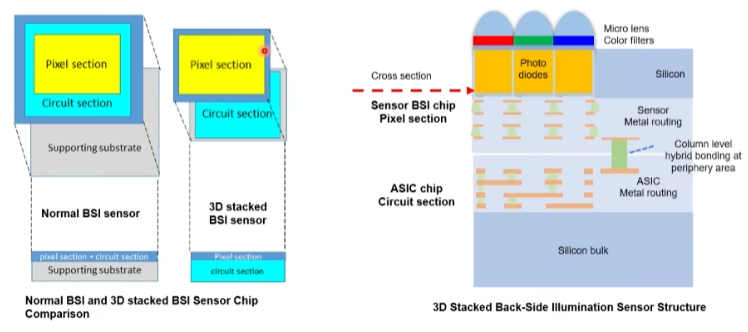

堆栈式(stack):堆栈式是在背照式上的一种改良,是将所有的线路层挪到感光元件的底层,使开口面积得以最大化,同时缩小了芯片的整体面积。对产品小型化有帮助。另外,感光元件周边的逻辑电路移到底部之后,理论上看逻辑电路对感光元件产生的效果影响就更小,电路噪声抑制得以优化,整体效果应该更优。相同像素的堆栈式芯片的物理尺寸是比背照式芯片的要小的。但堆栈式的生产工艺更复杂,良率更低,成本更高。

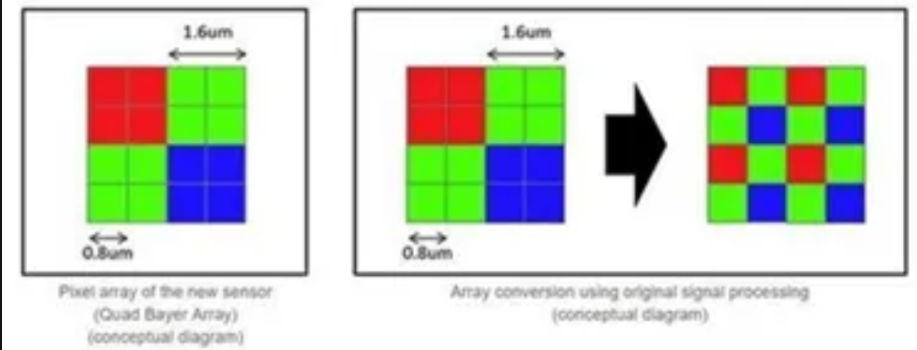

Quad Bayer 阵列(四合一像素技术):将四个同色像素排列在一起,形成一个大的像素。

像元电路结构

根据像素的不同结构,CMOS 图像传感器可以分为无源像素被动式传感器(PPS)和有源像素主动式传感器(APS)。根据光生电荷的不同产生方式,APS 又分为光敏二极管型、光栅型和对数响应型,现在又提出了 DPS(digital pixel sensor)的概念。

无源像素被动式传感器(PPS):由用于感光的光电二极管和选择开关(RS:Row Select)组成,select 信号选择像素读取光电二极管上的电荷。由于没有放大器,信号必须直接传输到读取线路,这会导致噪声大、信号衰减较快,影响图像质量,适用于早期的 CCD 传感器。PPS 单元结构简单、寻址简单、填充系数高、量子效率高等优点,但灵敏度低、读出噪声大。因此不利于向大型阵列发展,限制了应用,很快被 APS 代替。

工作方式:

- 开始曝光前,像素的行选择地址会上电,于是 RS 使能,连通 PN 结与列选择器(column bus),同时列选择器会上电,使 PN 结上加高反向电压(如 3.3 V),短暂延时后 PN 结内电子空穴对达到平衡,于是 reset 操作完成,RS 信号失效,隔断 PN 结与 column bus 的连通。

- 开始曝光时,PN 结内的硅在吸收光子激发出电子-空穴对。受 PN 结内电场的影响,电子会流向 PN 结的 n+端,空穴会流向 PN 结的 p-substrate。因此,曝光后的的 PN 结反向电压会降低。

- 曝光结束后,RS 再次使能,读出电路会测量 PN 结内的电压,该电压与原反向电压之间的差值即正比于 PN 结接受到的光子数。

- 在读出感光信号后,会对 PN 结进行再次 reset,准备下次曝光。

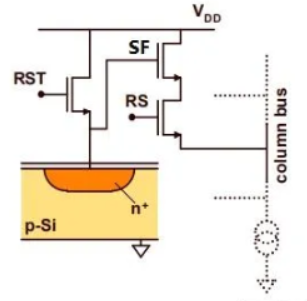

有源像素主动式传感器(APS):由光电二极管、用于清空像素电荷的复位二极管和用于提高信号强度提高图像质量的放大晶体管构成。由于具有信号放大功能,集成有源像素通常用于 CMOS 图像传感器,相比被动像素,其图像质量更高、噪声更低。APS 比 PPS 具有低读出噪声和高读出速率等优点,但像素单元结构复杂,填充系数降低。

以其中的 3T 结构为例,其工作方式为:

- 复位。使能 RST 给 PN 结加载反向电压,复位完成后撤销 RST。

- 曝光。与 Passive Pixel 原理相同。

- 读出。曝光完成后,RS 会被激活,PN 结中的信号被 SF 放大后读出。

- 循环。读出信号后,重新复位,曝光,读出,不断输出图像信号。

基于 PN 结的 Active Pixel 流行与 90 年代中期,它解决了很多噪声问题。但是由 PN 结复位引入的 kTC 噪声却并没有得到解决。为了解决复位 kTC 噪声,减小暗电流,在 3T 结构之后又出现了 PPD 结构(Pinned Photodiode Pixel),包括一个 PN 结感光区和 4 个晶体管,所以也称 4T 结构,它在 3T 结构的基础上增加了一个 TX 三极管起控制电荷转移的作用。PPD 的出现是 CMOS 性能的巨大突破,它允许相关双采样(CDS)电路的引入,消除了复位引入的 kTC 噪声,运放器引入的 1/f 噪声和 offset 噪声。 PPD 结构有 4 个晶体管,有的设计甚至有 5 个,这大大降低了像素的填充因子(即感光区占整个像素面积的比值),这会影响传感器的光电转换效率,进而影响传感器的噪声表现。为了解决这个问题又出现了 PPD 共享结构,像素的感光区和读出电路由 TX 晶体管隔开,相邻像素之间可以共用读出电路,如下图所示。2x2 像素共享一个读出电路,一共使用 7 个晶体管,平均一个像素 1.75 个晶体管。这样可以大大减少每个像素中读出电路占用的面积,提高填充因子。美中不足的是,由于 2x2 个像素的结构不一致,会导致固定模式噪声(FPN)的出现,需要在后续 ISP 处理中消除。

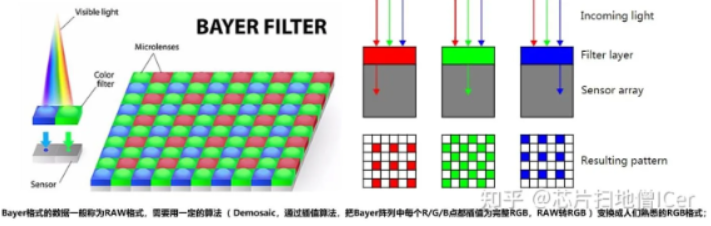

彩色滤波阵列

像素结构中提到的滤光膜,指的是彩色滤波阵列 CFA。CIS 本身只能捕捉光线强度,无法感受光的波长(颜色);CFA 用特定颜色的滤镜去除光谱中的一些成分,使每个像素只保留一种颜色成分。在传感器上叠加上一层有许多微型滤色器的矩阵,传感器只需要依据色彩矩阵记录下像素的光强即可,而后面的处理器通过三原色的光强就能拼配出色彩信息。

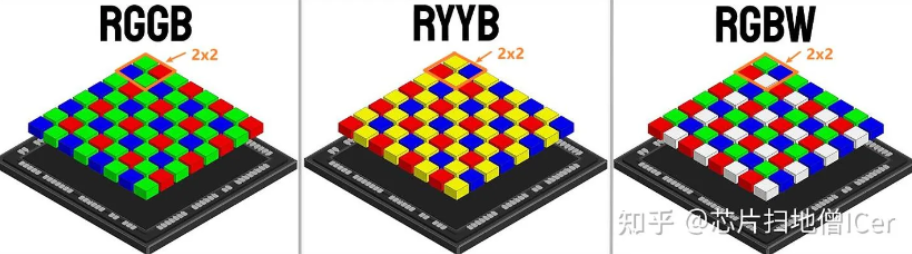

目前常用的图像传感器一般是「2×2 滤色阵列」,常见的有 RGGB / RYYB / RGBW 三种。

RGGB:从人眼的角度看,RGB 红绿蓝中的绿色 G 是最为敏感的,也更容易确定画面视觉细节,所以目前主流采用 RGGB,也称 Bayer 阵列。但由于自然界中绝大多数场景的光线成分不是这样分配的,直接导致整体进光量的损失,色彩信息也会有所浪费,因此需要后续处理。

RYYB:黄光的波峰介于红光和绿光之间,黄色滤色器能兼并红光和绿光,提高整个传感器的感光,增大进光量,暗拍能力强。但黄色的增加使得红色和绿色的量产生变化,黄色通道需要结合红蓝通道与之加减等复杂的运算组合,分析猜出原本红绿成分的强度,处理不好就会产生明显色偏,考研厂商调校。另外,由于黄光的进光量远超于红光和蓝光,而单个像素可承载的能量又是有限的,所以在一些光线强烈的场景下:

- 如果优先考虑 R、B 的可承载量,那么 Y 就可能会溢出,亮处会形成过曝而略显苍白

- 如果优先满足 Y 的承载量,那么 R、B 通道就可能欠曝光,最终导致大光比环境下宽容度不够高

这些都可以通过 ISP 算法调校,这一阵列由华为提出,目前也基本只有华为在使用

RGBW:RGBW 是仿照人眼视网膜感光细胞而设计的 CFA(人眼视网膜中拥有锥细胞和杆细胞两种独立运行的感光细胞:锥细胞用于感知颜色,主要在强光环境下工作,杆细胞用于感知光强,主要在暗光环境下工作),与 RYYB 类似,同样是提升进光量的思路,但把一个绿换成透明(white),去掉一个滤色器的传感器能用更多的通光量换来更大的感光,获得全域光(白光)的感知能力,暗拍能力增强;但 RGBW 的色彩普遍寡淡,且需要设计特定的 ISP 系统来匹配不同于普通 RGB 的成像逻辑,提高了厂商使用 RGBW 的门槛。

此外还有 RCCC,RCCB 等 CFA,C 表示 Clear 透传,可提高采光强度并使用专用的频带响应技术以提高图像的信噪比和可靠性。

没有 CFA 的传感器形式被称为 monochrome(MONO),即黑白传感器,MONO 传感器的层次过渡更加细腻,信噪比也更高。

CIS 经过 CFA 后每个像素只能感受单色光,此时存储的为 RAW DATA,要想将每个像素的 RAW DATA 还原成三基色,就需要 ISP 来处理。

四、性能指标

有效像素数

有效像素数(Number of effective pixels)指 CIS 中能够进行有效的光电转换并输出图像信号的像素。例如索尼的 IMX586,有效像素为 8000(H)×6000(V),表示横列像素数目为 8000,竖列像素数目为 6000,两个数字相乘为 4800 万,称为 48M 或者 48MP。M、MP 是 Megapixel(百万像素)的简称。

像素尺寸

像素尺寸(Pixel Size)是指单个感光元件的尺寸,一般有两种表述,比如 1.12μm 或者 1.12μm×1.12μm。像素尺寸越大,接收光子的数量就越多,同光照条件和曝光时间内产生的电荷也越多。对于弱光成像而言,像素尺寸是芯片灵敏度的一种表征。

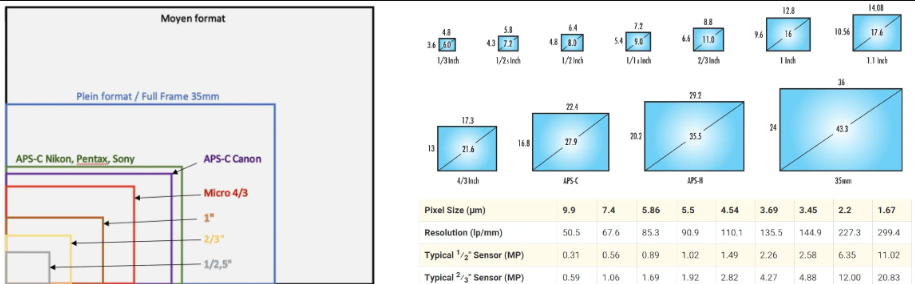

靶面尺寸/光学尺寸

靶面(Target Surface)是图像传感器上用于接收和感应光线的区域,也可以称为成像区域或有效感光区域,直接影响成像质量和视野。

较大的靶面具有更好的动态范围,能捕捉更多亮部暗部的细节;同时单个像素面积较大,在低光环境下表现较好。光学尺寸越大,则成像系统的尺寸越大,捕获的光子越多,感光性能越好,信噪比越低。靶面较小则可以获得较大的景深。(景深是指在摄影机镜头或其他成像器前沿着能够取得清晰图像的成像器轴线所测定的物体距离范围)另外,靶面大小也影响镜头的等效焦距。靶面尺寸的计算,理论上是传感器靶面的对角线长度,但由于历史原因,“一英寸传感器”指的是与直径一英寸的摄像管实际靶面面积相当。

常见的靶面尺寸如下(1 英寸=2.54 厘米,1 英尺=30.48 厘米)

- 中画幅的 sensor 典型尺寸为 44 或 53mm 宽,3 千万~1 亿像素。

- 全画幅的 sensor 典型尺寸为 35mm 宽,和早期的电影胶片一样大,具有 1 千万~5 千万像素不等。

- APS-C sensor 典型尺寸 22mm 宽,是单反相机的主力军,具有 6 百万~5 千万像素不等。

- 4/3 英寸画幅 sensor,典型尺寸 17.3mm 宽,微单产品的主力,具有 8 百万~2 千万像素不等。

- 1 英寸画幅 sensor,典型尺寸 13.2mm 宽,用于单反和高端安防产品

- 1/3~2/3 英寸 sensor,便携 camera 和安防 camera 的主力军,1 百万~2 千万像素不等。

- 1/4~1/2 英寸 sensor,主要用于手机 camera 模组,8 百万~4 千万像素不等。

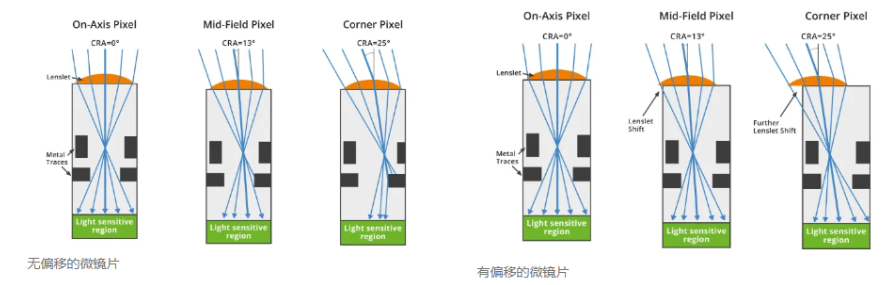

主光线角度

主光线角度(Chief Ray Angle,CRA)又叫主光线入射角,指的是从镜头中心通过像素中心的光线与传感器表面之间的角度,影响光线如何投射到传感器的每个像素上。光线投射到像素中心的角度由相机镜头的 CRA 和 CIS 微透镜的开口布局共同决定。另外,相机的镜头和 CIS 各有一个 CRA 参数,CIS 的 CRA 指像素表面微透镜的主光线角度。镜头的 CRA 与 CIS 的 CRA 值越接近越好,一般建议角度差控制在正负 2 到 3 度之间;更具体地说,镜头的 CRA 一般略大于 CIS 的 CRA,因为镜头 CRA 小于 CIS 的 CRA 时会出现偏色现象(偏色是指像素之间的串扰,导致成像出现颜色阴影的现象)。较大的 CRA 可能导致角落或边缘像素的光线投射效率降低,影响图像的均匀性和清晰度。之所以要设计 CIS 的 CRA,使传感器的微透镜和光电二极管的位置存在一定的水平误差,是为了更好地搭配镜头,因为 CRA 为 0 度的镜头不容易找到。

快门方式

CMOS 传感器的快门方式有全局快门(Global Shutter)和卷帘快门(Rolling Shutter)两种。

- 全局快门:拍摄瞬间传感器所有像素同时曝光,能够在同一时刻捕获整个画面的图像信息。在面对快速运动的物体时,全局快门能够避免因扫描延迟导致的物体变形和扭曲现象(即果冻效应)。且全局快门同步性好,适用于需要精确时间同步的应用场景,如多相机协同拍摄系统中,各相机可同时曝光,保证图像采集的一致性。但由于每个像素都需要额外的存储单元来暂存曝光信息,成本较高;另外,额外的存储单元占据了像素面积,像素感光面积有所减小。

- 卷帘快门:拍摄瞬间传感器像素逐行曝光,如同卷帘一样依次展开,直到整个画面曝光完成。不需要为每个像素配备存储单元,电路结构相对简单,成本相对较低。相较于全局快门,因为没有额外存储单元占用像素面积,像素尺寸可以做得更小,有利于提高图像传感器的分辨率和在低光照条件下的性能。缺点是存在果冻效应(拍摄快速运动物体或相机快速移动时,由于逐行曝光存在时间差,会导致拍摄的物体出现变形、扭曲,类似果冻抖动的效果,影响图像质量),且同步性较差,不适用于需要精确同步曝光的应用场景。

焦距决定视场,快门决定记录这个空间所需要的时间。快门速度就是帧率的倒数。

感光度/灵敏度阈值

灵敏度阈值(Absolute Sensitivity Threshold)用于衡量 CIS 对入射光功率的响应能力,常用的定义是在 1μm2 单位像素面积上,标准曝光条件下(1Lux 照度,F5.6 光圈),在 1s 时间内积累的光子数能激励出多少 mV 的输出电压,通常以 mV/lux-sec 为单位。绝对灵敏度阈值指的是传感器能够检测到的最小光照强度,通常表示为使传感器能够产生一个可区分于杂讯的信号所需的最小光子数量。在量子效率一定的情况下,灵敏度阈值主要取决于电荷/电压转换系数(Charge/Voltage Factor, CVF)。绝对灵敏度阈值越低,CIS 在低照度下就能捕获越丰富的细节,相应地在拍摄时可以匹配更高地快门速度,有利于拍摄运动物体和夜间场景。与感光度类似的指标还有安防领域应用较多的近红外感光度(NIR,Near Infra-red。850nm-940nm),含义与灵敏度完全一致。

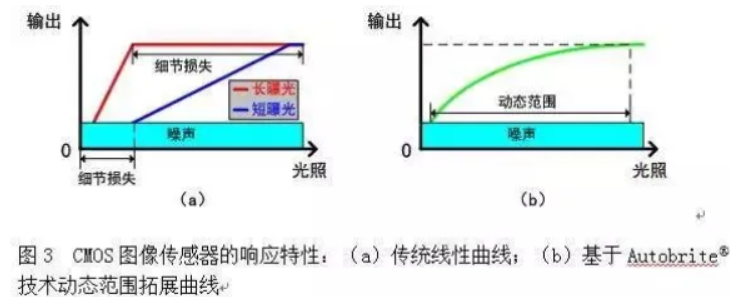

动态范围

动态范围(Dynamic Range)表示图像中所包含的从“最暗”至“最亮”的取值范围。根据 ISO15739 的定义,“最亮”指的是能够使输出编码值达到特定“饱和值”的亮度;而“最暗”指的是图像信噪比下降至 1.0 时的亮度。(也有的定义为最大非饱和输入信号(光电流)$I_{max}$与最小可检测输入信号$I_{min}$的比值),通常表示以分贝表示。动态范围取决于 CIS 的信号处理能力和噪声水平,前者一般由像素的满阱容量决定,后者一般由读出噪声主导。动态范围决定了传感器捕捉影像时可区分的亮度范围。一个宽广的动态范围使传感器能够在极端亮暗条件下都能捕捉到细节。

另外,ADC 位数的选择必须是和 CIS 的动态范围相适配的,ADC 位数高于 CIS 是没有任何意义的性能浪费,低于 CIS 则不能完全发挥出性能优势。主流的单反相机采用 14 位 ADC,更高端的则采用 16 位 ADC。

光谱响应特性

光谱响应特性(Spectral Response Characteristic)指的是 CIS 信号电压 Vs 和信号电流 Is 与入射光波长 λ 之间的函数关系,决定了 CMOS 图像传感器的光谱范围。

量子效率

量子效率(Quantum Efficiency)指在某一特定波长下,单位时间内产生的平均光电子数与入射光子数之比,描述了感测器将入射光子转换为电子的效率。量子效率越高,CIS 感光度就越高,从而捕捉更多的影像细节,尤其是在光照不足的环境中。量子效率主要取决于光电二极管 PN 结截面的结构和大小,通常在 10%-80%之间,并且与波长有密切关系。硅基半导体的能带宽度(Band Gap)决定了其对绿光(波长 550nm)的量子效率最高,对红外光段的感测效果较差。

满阱容量

满阱容量(Full Well Capacity,FWC)又称饱和容量(Saturation Capacity)或势阱容量,指的是单个像素在达到最大亮度值之前像素能够积累的最大光电荷量,决定了像素在极端亮光条件下的表现,高满阱容量意味着传感器能够在不过度曝光的情况下捕捉更亮的场景,动态性能也就更好。消费类 CIS 的 FWC 一般以 2000~4000 较为常见。超过 FWC 的上限,电荷就有可能渗漏到邻近的像素导致溢出模糊,反映到图像上则类似于过曝,呈现一片特别亮的区域。解决过曝可通过在像素单元内加入自动泄放管来将过剩电荷排出,但已经不能使像素真实还原出图像了。

满阱容量对一系列性能指标皆有影响:

- 对动态范围的影响:满阱容量越大,图像传感器能够捕捉到的亮度范围就越广,可以在亮部不过曝的情况下,更好地保留暗部细节,扩大动态范围。

- 对信噪比的影响:较高的满阱容量有助于提高信噪比。在相同的噪声水平下,能够容纳更多信号电荷意味着信号强度相对更高,图像质量更清晰,噪点更少。

- 对色彩还原的影响:如果满阱容量不足,在强光下某些颜色通道可能会先饱和,导致颜色信息丢失或失真;足够的满阱容量能保证各个颜色通道在合理的光照范围内都能正常工作

- 对曝光宽容度的影响:满阱容量大在曝光设置上有更大的宽容度。既可以在长曝光时间下捕捉微弱信号,用于拍摄夜景等低光照场景;也能在高光照条件下避免像素过早饱和。

系统增益

系统增益(Overall System Gain)表征了传感器对光信号的反应和后续电子处理过程的放大能力。此处的增益是指信号放大的比例,通常包括数字增益和模拟增益,大部分 CMOS 都拥有这两种增益且可以独立调整倍数,最终效果为两者相乘。然而,由于增益在放大信号的同时也会放大噪音,因此增益并非越高越好。系统增益直接影响影像的亮度和对比度,高的系统增益使传感器能够在光线较弱的条件下捕捉到更多的细节。

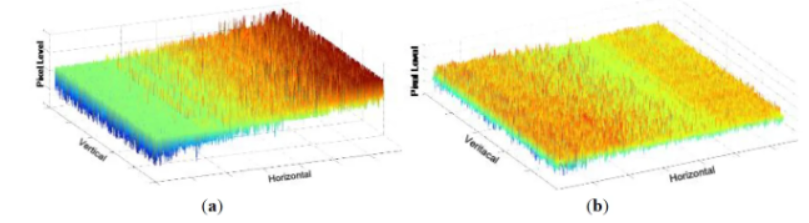

空间非均匀性

空间非均匀性有 DSNU 和 PRNU 两种:DSNU 是指在没有光源(暗环境)下,传感器各像素点输出信号的一致性。这种不一致性通常来自制程中的微小变异或元件的老化现象。DSNU 会导致影像出现不均匀的暗部,特别在低光照条件下更为明显,影响到影像的整体品质和对比度。PRNU 指的是在均匀光照下,感知器各像素对光的灰度响应存在的不均匀性和非线性,通常由像素大小、形状或材料特性上的微小差异导致。PRNU 会造成影像在亮度和色彩上的不均匀,影响影像的自然度和真实感。

线性度误差

线性度误差(Linearity Error)指的是感测器输出与光强度输入之间的关系偏离理想线性响应的程度。理想状态下,感测器输出应与光强度成正比。在高线性度误差的情况下,感测器可能无法准确地反映场景的亮度变化,从而影响影像质量。高性能影像感测器的线性偏差通常只有几个百分点。

信噪比

信噪比 SNR(Signal-to-Noise Ratio)反映了传感器输出的有效信号强度和背景噪声强度之间的关系,一般以用分贝表示。SNR 其实是用来衡量传感器某一时刻输出的图片质量,而不是表征传感器能力的指标。一般摄像机给出的信噪比值均是 AGC(自动增益控制)关闭时的值,因为当 AGC 接通时,会对小信号进行提升,使得噪声电平也相应提高。信噪比的典型值为 45 ~ 55dB,若为 50dB,则图像有少量噪声,但图像质量良好;若为 60dB,则图像质量优良,不出现噪声。

像素密度

像素密度也是用于衡量传感器某一时刻输出的图片质量的指标。在印刷行业中,描述一幅图像的质量通常会使用“像素密度”的概念,一种常用的定义是 PPI(pixel per inch)或 DPI(dot per inch),即每英寸长度上(1in=25.4mm)打印多少个像素点。在我国一般采用国际单位体系,像素密度通常用 PPM(pixels per meter)单位。在安防行业中,人们一般将图像质量从高到低分为 5 个等级,每个等级可以满足一定的应用需求。

五、相关技术

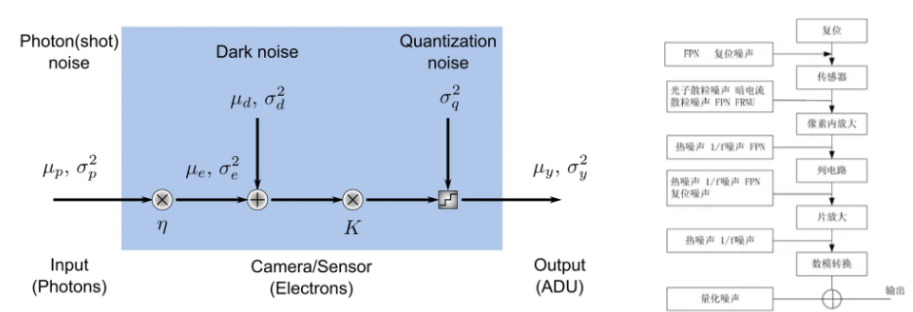

噪声分析和处理

假设照明强度恒定均匀,相机拍摄图像中的噪声是测量信号中空间和时间振动的总和。下图总结了 CIS 在工作过程中的主要噪声

固定模式噪声(σF, Fixed-pattern noise FPN):该噪声是由像素的空间不均匀性引起的,CMOS sensor 每个像素内都配置一个电荷电压放大器,每行、每列都有一些晶体管用于控制像素的复位和读出,这些器件的工作参数相对理论值的漂移导致一束同样的光照射到两个不同的像素上产生的输出信号不完全相同,构成固定模式噪声。另外,坏像素、瑕疵像素也可以视为一种固定模式噪声。在所有像素中,总会有一些像素相对平均值漂移较大,这些像素称为离群像素(outliers)。固定模式噪声是固定不变的,与信号高低水平和传感器温度无关,因此可以通过标定的方法减除,在计算噪声时可忽略该项。

kTC 噪声 (σR, Reset Noise)/复位噪声:当 RS 使能且列选择器通高电平时,在电路原理上相当于对 PN 结的电容进行充电,但是充电后得到的电压值却有一定的随机性,一方面每个 PN 结的实际电容大小会服从一定的概率分布,结与结之间存在固定的偏差,这会构成一种固定模式噪声;另一方面由于电路中存在暗电流噪声,即使是同一个结每次充电后得到的实际电压也不完全一样,这就构成了另一种模式的噪声,它与 PN 结的结构、温度和结电容大小都有关。由电子热运动引起的宽带热噪声经 PN 结滤波后反应在结电容上的输出噪声功率用 kT/C 描述,其中 T 为 PN 结温度,C 为结电容,k 为常系数,故称为 kTC 噪声。

另外,对势阱复位过程中会将势阱中自由积累的电荷全部释放,为后续的读出准备。但是由于暗电流的存在,每次复位后都会残留一些大小随机的噪声信号,即复位噪声,其本质就是 kTC 噪声。另外,像素的复位需要一定时间。定量研究表明,即使是采用较大的复位电流,一般也需要 1ms 以上的时间才能将电荷释放干净,而实际的复位控制信号通常会短于 1ms,因此下一帧图像多多少少会残存一些上一帧图像的影子,这个残影叫做 image lag,也是噪声的一种形式。

光子散粒噪声(σS, Shot Noise):该噪声是与落在传感器像素上光子相关的统计噪声。在微观尺度下,光子流到达传感器的行为在时间和空间上都是不均匀的,整体上其统计规律符合泊松分布。光子散粒噪声是与被测信号的高低水平有关的,与传感器温度无关。

暗电流噪声/暗散粒噪声(σD, Dark Noise):像素单元由于杂质、受热或其它原因,导致一些价电子即没有光照射也会随机激发至导带中形成暗电流(dark current)。暗电流与光照产生的电流很难进行区分。暗电流在像素阵列各处也不完全相同,会导致固定图形噪声。暗电流的产生是一个随机过程,是散弹噪声的一个来源,会影响图像的对比度和清晰度。暗电流变化的主要原因是电子穿过 PN 结时会遇到 PN 结的电势屏障(barrier),电子穿越屏障需要经历动能-势能-动能的转换过程,所以需要耗费一些时间。暗散粒噪声在统计上服从泊松分布,与光信号的高低水平无关,但与传感器的温度有关,一般的规律是温度每升高 8°C 暗电流翻一倍。使用长时间的积分单元时,这种类型的噪声就变成了影响图像信号质量的主要因素,因此对暗电流噪声的处理在低光照条件或长时间曝光的应用中显得尤为关键。为减少暗电流对图像信号的影响,在设计电路时必须注意把容易发热的电子元件尽可能布置在远离 CIS 的地方。此外可以采取降温手段。在科学、武器等应用中常会使用液氮给 sensor 制冷以提高图像信噪比。 很多装备了 CCD/CMOS camera 的导弹会带一个盛液氮的杜瓦瓶,导弹开机后杜瓦瓶向 sensor 吹冷气使 sensor 保持在零下几十度低温工作。由暗电流产生的固定图形噪声不能完全通过双采样克服,目前采用的方法是从已获得的图像信号中减去参考暗电流信号。

非线性响应噪声 (σp):英文为 PRNU,Photo Response Non-Uniformity。Bayer 格式的 CFA 存在四种像素(R,Gr,Gb,B),这四种像素的光电转换特性(即增益特性)不可能完全一样,不同种像素间存在种间差异,同种像素之间也存在个体差异。PRNU 通常占总噪声的 1~2%左右,很多时候可以忽略。当信号较大时光信号本身的散粒噪声远大于像素的非线性响应噪声。

1/f 噪声 (σf):1/f 噪声是一种低频噪声,在有些文献中也称 flicker noise(闪烁噪声) 或 pink noise(粉红噪声),它广泛存在于半导体器件中。在低频的时候 1/f 噪声一般显著高于电散粒噪声。

量化噪声(σQ, Quantization Noise):该噪声是在产生电子信号时生成的。CIS 中使用 AD 转换器将模拟放大器输出的模拟电压采样为数字电压。由于数字信号的精度总是有限的,通常为 10 比特至 14 比特,幅值位于两个相邻数字之间的模拟信号会四舍五入到最接近的数值,引入量化噪声。该噪声由传感器的设计决定,意义是至少需要多少个电子才能驱动读出电路的 ADC 变化一个比特。它与信号高低水平和传感器温度无关。

条带噪声(Banding Noise):它的一种来源与像素参数和 ADC 参数的飘移有关,此时它是一种 FPN 噪声,但有时它是由外部电压不稳定造成的,此时它是一种随机噪声。只有 sensor 厂家才有条件研究清楚这两种噪声来源的具体比例结构。

串扰噪声:英文为 Crosstalk,通信领域中指两条信号线之间由于屏蔽不良而发生信号耦合,一条线路上的信号通过线缆间存在的互感和互容馈送到了附近的信号线上。此处的串扰指入射到一个像素的光信号没有在这个像素里被捕获,反而被其周围的像素捕获,导致周围的像素产生了不该有的信号。这种情况下,错误响应的像素响应会太高,并且会扭曲真实像素颜色。波长越长,串扰越严重,某些像素位置串扰能量可以达到 5%。

目前,减少小像素中的串扰已成为传感器设计中最困难和最耗时的任务之一。三星公司研发了 ISOCELL 技术用于抑制串扰,该技术使用 metal grid 制造电势屏障阻止电子进入相邻的像素,但是会引入一些新的问题,所以后来又发展出了 ISOCELL Plus 技术,该技术是在 ISOCELL 的基础上改进了材料,避免了 metal grid 引起的不良反应。索尼的 HAD CCD 技术给像素设计了一个特别的盖子,可以防止像素内的光电子逃逸,同时也防止像素外的自由电子进入像素内部。

尽管像素噪声有多种来源,但每种噪声的贡献程度并不是同等重要的。为了简化计算,实际经常采用简化的噪声模型,只考虑光散粒噪声、暗散粒噪声和量化噪声,每个像素的总有效噪声可量化为$\sigma _ { e f f } \, = \, \sqrt { \sigma _ { S } ^ { 2 } + \sigma _ { D } ^ { 2 } + \sigma _ { Q } ^ { 2 } }$

处理固定图形噪声可以应用双采样或相关双采样技术

- 双采样是先读出光照产生的电荷积分信号,暂存然后对象素单元进行复位,再读取此象素单元地输出信号。两者相减得出图像信号。

- 双相关采样(Correlated Double Samping,CDS)的基本思想也是进行两次采样,先采样一个参考信号用于评估背景噪声,延迟很短时间后再采集目标信号,从第二次采样中减去参考信号。相关双采样需要临时存储单元,随着象素地增加,存储单元也要增加。

在两次采样间背景噪声的幅度变化不大的前提下,两种采样均能有效抑制固定噪声和低频噪声,如 1/f 噪声,kTC 噪声等。

CDS 技术对像素低频噪声的过滤效果

此外,图像传感器上会设计不参与正常图像感光成像的特定像素区域,用于检测并补偿传感器本身的噪声、暗电流等干扰因素,称为光学黑(Optical black)。通过对这些光学黑像素所产生信号的测量和分析,可对正常感光像素的信号进行校准和修正,从而提高图像质量,减少噪声和暗电流等对最终成像效果的影响。

而在图像后处理中,常见的降噪方法有

- 时域降噪(Temporal Noise Reduction, TNR):利用前后帧信息去除噪声

- 空域降噪(Spatial Noise Reduction, SNR):平滑处理当前帧的噪声点。

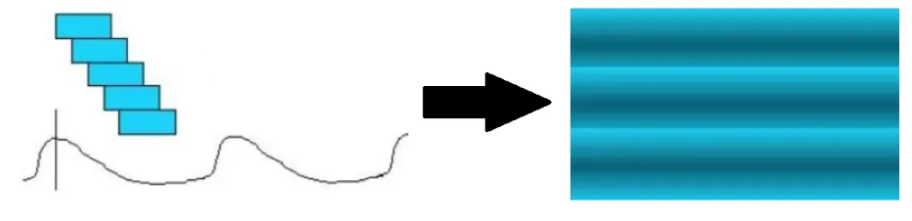

工频闪烁

工频闪烁(flicker)是由于曝光时间设置不是光源能量周期的整数倍,导致图像不同位置处积累的信号强度不同,并呈周期性变化。在图像上表现为条纹模式,在视频序列上则表现为条纹模式在垂直方向上缓慢移动。工频闪烁的形成原因与卷帘快门的工作原理相关,并且受交流电的频率影响,本质是像素曝光起始点相对交流电的相位关系在不断变化。对于同样的积分时间,传感器不同位置处的像点开始积分时所处电信号的相位不同,导致同样时间内能够积累的光子数也不同。在室内,为了避免工频闪烁,曝光时间应设置为光源能量周期的整数倍。在中国,光源能量周期为 10ms(交流电周期的 1/2),在美国则为 8.3ms。

传输接口

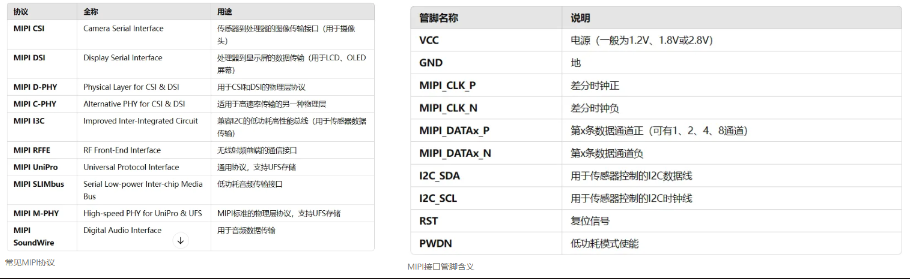

传输接口用于将传感器采集到的图像数据传输到后续处理单元(如 ISP 或 FPGA 等)。主要有 MIPI、DVP、LVDS、Parallel、HISPI 以及索尼的 SLVS、Sub-LVDS、SLVS - EC 接口等。

MIPI(Mobile Industry Processor Interface),是定义移动设备内置处理器接口的标准,指定了用于移动和便携式设备的接口,是一种高速接口标准。

MIPI 接口使用串行通信传输数据(减少线路),使用差分信号传输(噪声和干扰小),支持多路复用(节省空间和成本),支持不同的数据编码格式(包括 RGB、YUV 和 RAW 等),支持不同的数据位宽(包括 8 位、10 位和 12 位等)。MIPI 传输速率通常在几百 Mbps 到几 Gbps 之间,支持高清视频和高质量音频的传输,具体的传输速率取决于其使用的物理层协议。MIPI 联盟定义了多种物理层协议,包括 MIPI D-PHY(最高 1.5Gbps)、MIPI C-PHY(最高 6Gbps)和 MIPI M-PHY(最高 11.6Gbps)等。

MIPI 的 camera 接口叫 CSI,MIPI 的 display 接口叫 DSI。MIPI CSI 是移动设备和嵌入式视觉系统中最常用的高速串行接口,差分信号传输、点对点通信、通道数可选,目前版本为 CSI-2 和 CSI-3(高速)。MIPI 摄像头有三个电源:VDDIO(IO 电源),AVDD(模拟电源),DVDD(内核数字电源),不同 sensor 模组的摄像头供电不同,AVDD 有 2.8V 或 3.3V 的;DVDD 一般使用 1.5V 或更高,不同厂家的设计不同,1.5V 可能由 sensor 模组提供或外部供给,可以使用外部供电则建议使用外部供,电压需大于内部的 DVDD;VDDIO 电压应与 MIPI 信号线的电平一致,若信号线是 2.8V 电平,则 VDDIO 也应供 2.8V,有些 sensor 模组也可以不供 VDDIO,由内部提供。MIPI 总线速率 LVDS 接口耦合,走线必须差分等长,并且需要保护,对 PCB 走线以及阻抗控制要求高一点(一般来讲差分阻抗要求在 85 欧姆~125 欧姆之间)。

(注:除了 MIPI 之外,其它高速接口还包括 USB、雷电接口、HDMI、SATA、LVDS 等。MIPI 主要用于 SoC 和相机、或 SoC 和显示器之间的图像传输,搭载 SoC 的设备一般集成了完整的功能,MIPI 是用于内部连接这些集成设备的接口,普通消费者一般接触不到,故知名度不像 USB 或雷电接口那样高)

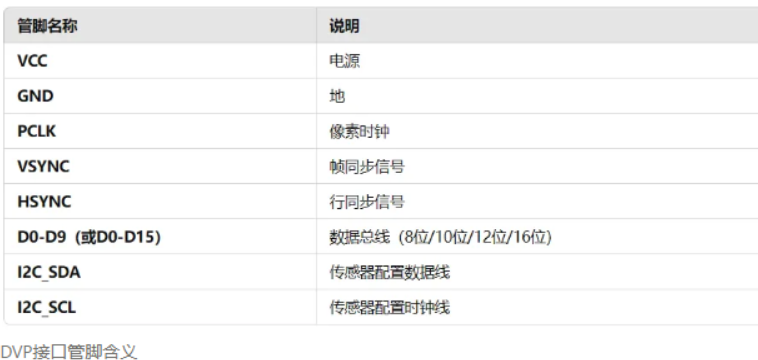

- DVP(Digital Video Port)是并口,可以传输 8/10/12 bits 数据,速度较慢,传输的宽带低。DVP 总线 PCLK 极限约在 96M 左右,而且走线长度不能过长,所有 DVP 最大速率最好控制在 72M 以下,PCB layout 较容易画。DVP 占用的数据线较多,逻辑设计上也比较复杂,需要严格同步包括水平同步信号,垂直同步信号以及时钟信号,这对摄像头这端以及接收器这端都提出了较高的要求,同时,在高速传输的过程中,直接使用数字信号作为数据容易被其他外部信号干扰,不如差分信号的稳定性,这样也大大限制了其传输的速率以及相机最大能够实时传输的图像质量。MIPI 接口比 DVP 的接口信号线少,由于是低压差分信号,产生的干扰小,抗干扰能力也强。最重要的是 DVP 接口在信号完整性方面受限制,速率也受限制。500W 还可以勉强用 DVP,800W 及以上都采用 MIPI 接口。

DVP 接口管脚含义

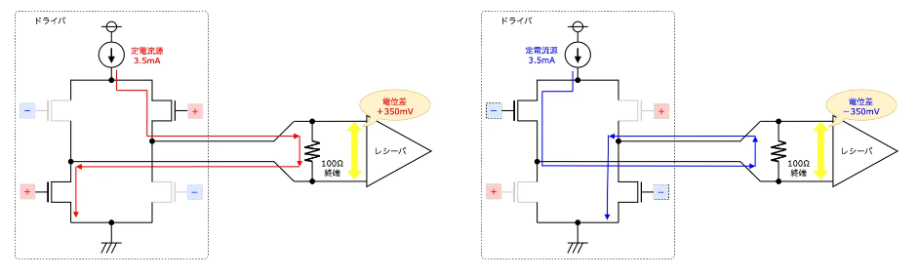

LVDS(Low Voltage Differential Signal),全称低电压差分信号,传输速率高、抗噪声和干扰能力强、功耗低,是物理层的标准。

单端信号使用相对于 GND 的电压电平来表达二进制值(常见的 CMOS 和 TTL 等 IO 标准就是单端的),差分信号通过控制电流流动的方向来表达 H 电平/L 电平。在 LVDS 的情况下,一般以 ±350mV 的幅度驱动。差分传输具有抗共模噪声、高数据速率、低功耗、低成本的优点。另外由于电流在两条差分线中流向相反的方向,因此产生的磁场抵消了差异。电路始终处于导通状态(H 电平和 L 电平中流过不同方向的电流),因此晶体管导通/关闭时不会产生开关噪声。

另外,信号转换时间(上升/下降时间)是高速传输信号的一个问题。这是因为如果高频信号的过渡时间较长,则幅度无法保持(电平会衰减)。为了缩短信号转变时间提高传输速率,降低信号幅度是有效的。如果振幅较低,则难以确保逻辑阈值的噪声容限,但差分传输方法本身抗噪声能力强,因此更容易降低振幅。实际 LVDS 使用条件下建议的最大数据速率为 655Mbps(理论无损传输线上的最大值为 1.923Gbps)。LVDS 接收器的输入阻抗非常高,因此流入电路的大部分电流流过 100Ω 终端电阻。终端电阻消耗的功率为 3.5mA*350mV = 1.2mW。与 CMOS 和 TTL 等单端传输方法相比,其功耗不到 1/10。

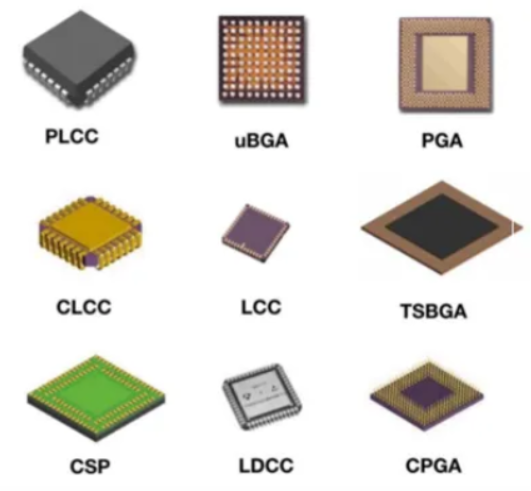

封装

CIS 封装主要有 COB、CSP、PLCC、BGA、LGA、PGA 等封装方式。

COB(Chip On Board):将裸芯片用导电或非导电胶粘附在互连基板上,然后进行引线键合实现其电连接的技术,也称为顶部包封技术。COB 可将镜片、感光芯片、ISP 以及软板整合在一起,封装测试后可直接交给组装厂,但是制作过程中容易遭受污染,对环境要求较高,制程设备成本较高、良品率变动大、制程时间长,无法维修等。

CSP(Chip Scale Package):芯片级封装,芯片感光面被一层玻璃保护,对灰尘点要求相对低,制程设备成本较低、制程时间短,但是光线穿透率不佳、价格较贵、高度较高、背光穿透有鬼影现象。CSP 是在 BGA 的基础上发展起来,极接近芯片尺寸的封装产品,拥有体积小、电性能良好和散热优良等特点。

PLCC:将 CIS 通过 COB 制程打到基板上,然后再盖上支架和贴上 IR,成为 PLCC。PLCC 的底部四边含有焊盘,这样就可以通过 SMT 方式把 PLCC 打到 FPC 上,SMT 后可以再组装马达和镜头做成摄像头模组。

BGA::球形触点陈列,表面贴装型封装

LGA::平面网格阵列封装

PGA:插针网格阵列封装

Fan-out:扇出晶圆级封装

六、补充知识

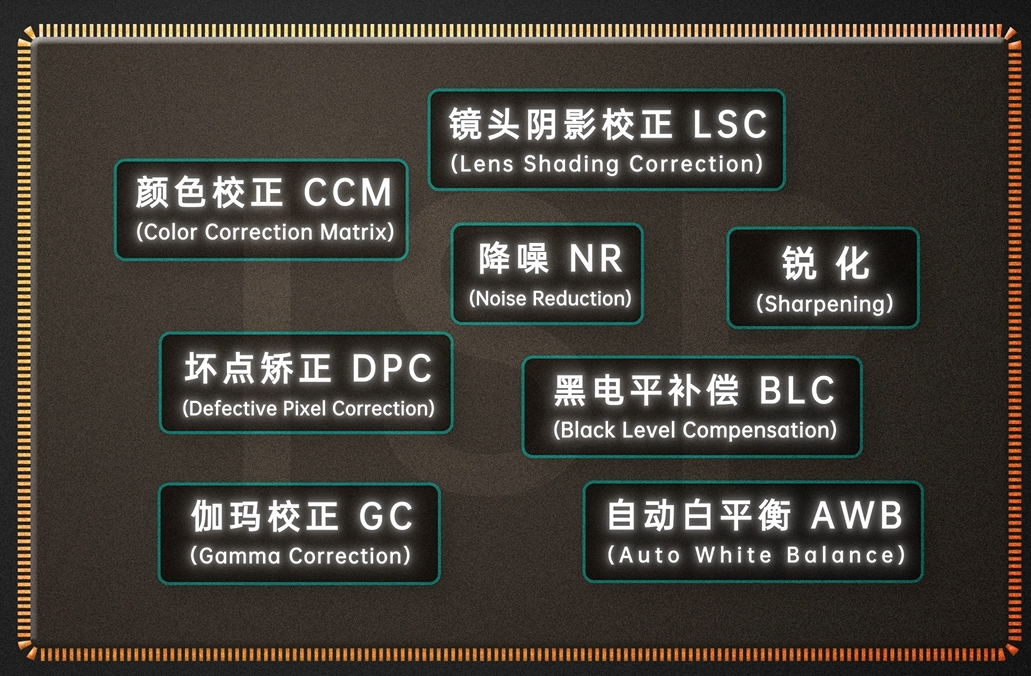

ISP 相关

有的传感器 IC 集成了 ISP,IC 采集到的 RAW DATA 经过 AWB、color matrix、lens shading、gamma、sharpness、AE 和 de-noise 等一系列后处理,输出 YUV 或 RGB 格式的数据;没有集成的则将 RAW DATA 格式的数据传输到 baseband 由外部 ISP 处理。DSP 是专门用于处理数字信号的芯片,可加速计算图像处理算法,提高最终成像质量。

以下是一些常见 ISP 的科普级介绍:

- AWB(Auto White Balance):自动白平衡,一种用于矫正图像的色温的图像处理技术,通过修正光源色偏,确保白色物体在不同光照条件下仍然呈现正确的颜色。

- Gamma 校正:用于调整图像的亮度和对比度,使其适合人眼观看。人眼对暗部细节更敏感,因此 Gamma 校正可以增强暗部细节,同时避免高亮部分过曝。

- 色彩矩阵:一种颜色转换算法,用于校正传感器采集的颜色,使其更接近人眼感知的颜色。

- LSC(Lens Shading Correction):镜头阴影校正:由于光线穿过镜头时会产生不同程度的光损耗,导致图像中心亮四角暗。LSC 的作用就是均衡亮度,使图像亮度更加均匀。

- 锐度增强:用于提高图像的清晰度,使边缘更清晰。通过边缘检测算法增强对比度,使细节更清楚。

- AE(Auto Exposure):自动调整曝光参数(如快门速度、ISO),确保图像亮度适中,避免过暗或过曝。

- 降噪(De-noise):用于减少 Sensor 采集的图像噪点,提高画质。

从 RAW 数据计算 RGB 数据的过程在数学上是一种不适定问题(ill-posed problem),理论上有无穷多种方法,因此与其说是一种科学,不如说是一种艺术。上述过程(插值)常称为 Bayer Demosaic,或者 Debayer,经过此操作之后,每个像素就包含了 3 个完整的颜色分量。为了提高光能量的利用率,人们提出了 RYYB 的 pattern,这是基于 CMY 三基色的 CFA pattern,Cyan 是青色(Red 的补色),Magenta 是品红(Green 的补色),Yellow 是黄色(Blue 的补色)。

快门

快门(Shutter)用于控制图像传感器的感光时间,由于图像传感器的感光值就是信号电荷的积累,感光越长,信号电荷积累时间也越长,输出信号电流的幅值也越大。电子快门越快,感光度越低,适合在强光下拍摄。快门速度指的是曝光时长,而不是机械快门的运动速度。Global Shutter(全局快门)与 RollingShutter(卷帘快门)对应全局曝光和卷帘曝光模式。卷帘快门逐行曝光的方式,全局快门在每一个像素上添加了一个存储单元,全部像素同时曝光,能够拍运动的物体而不产生形变。

景深和镜头 F 值

相机镜头的 F 值是用来表示光圈大小的指标,也叫光圈值、光圈系数,其定义为镜头的焦距除以镜头光圈的直径,即 F 值 = 镜头的焦距 / 镜头光圈的直径 。F 值大小决定单位时间内通过镜头进入感光元件的光线多少。F 值越小,光圈直径越大,通光量越大,进光越多;反之,F 值越大,光圈直径越小,通光量越小,进光越少。例如在夜景等光线暗淡场景,使用小 F 值(大光圈)可让更多光线进入,利于拍摄。景深指在相机镜头或其他成像器前,可保持清晰图像的成像深度范围。F 值小(光圈大),景深浅,画面中只有对焦的主体清晰,背景等会被虚化;F 值大(光圈小),景深深,画面前后更多景物都能清晰呈现。比如拍摄人像特写用大光圈虚化背景突出主体;拍摄风光、建筑用小光圈使远近景物都清晰。

CMYK

CMY 是青(Cyan)、洋红(或品红)(Magenta)和黄(Yellow)三种颜色的简写,加上黑色(Black),即为相减混色模式。CMYK 是一种色料颜色,是光线照射到物体表面后再反射到人眼中的颜色,由于物体表面会吸收部分颜色波长的光,CMYK 减少了为视觉系统识别颜色所需要的反射光以便人眼能够更好识别原本的颜色;相应的,最常用的 RGB 是一种光源色彩,即光线不经过反射直接照射到人眼中的颜色。

YUV

YUV 三个字母中,其中”Y”表示明亮度(Luminance 或 Luma),也就是灰度值;而”U”和”V”表示的则是色度(Chrominance 或 Chroma),作用是描述影像色彩及饱和度,用于指定像素的颜色。YUV 存储格式有两大类:planar(平面格式)和 packed(打包格式)。

CCI

CCI(Camera Control Interface)是一种基于 I²C 协议的低速控制接口,用于配置和控制图像传感器,是摄像头传感器(Camera Sensor)和处理器(SoC、ISP、FPGA)之间的接口标准,用于控制和配置摄像头传感器(类似 I²C 总线)。通过 CCI,主控芯片(如 SoC、ISP、FPGA)可以向摄像头传感器发送命令,控制其工作模式。比如设置曝光时间、调整白平衡、切换帧率选择分辨率、开关夜间模式等

CSI

CSI(Camera Serial Interface)是 MIPI(Mobile Industry Processor Interface)联盟制定的摄像头高速数据传输接口,用于传输 RAW、YUV 或 RGB 格式的图像数据,是摄像头传感器(Camera Sensor)和处理器(SoC、ISP、FPGA)之间的接口标准,用于高速传输摄像头的图像数据。采用差分串行传输方式,支持高分辨率、高帧率的图像数据流。CSI-2 基于 D-PHY 或 C-PHY,采用 LVDS,支持 1、2、4、8 通道扩展带宽。

EIS

电子图像稳定技术(Electronic image stabilization),是一种通过软件算法来减少因拍摄设备抖动而产生图像模糊的技术。在拍摄过程中,设备的传感器会实时检测到因手抖、移动等原因导致的微小晃动,然后 EIS 算法会对这些数据进行分析处理。接着,算法会对每一帧图像进行适当的裁剪、位移或变形等操作,从而补偿因抖动造成的画面不稳定,让最终呈现出的图像或视频更加平稳、清晰。

HDR

HDR 即高动态范围(High - Dynamic Range)技术,是一种提升图像和视频画质表现的技术。原理为在图像或视频拍摄时,通过不同曝光时间拍摄多张照片或多帧画面,然后将这些图像进行合成。例如,一张照片捕捉亮部细节,一张捕捉暗部细节,再将它们合成为一张具有更宽亮度范围的图像,从而让画面中的亮部不过曝、暗部有细节。在视频领域,一些设备则是通过算法实时处理不同曝光帧来实现动态 HDR 效果。

WDR

WDR 即宽动态范围(Wide Dynamic Range)技术,是一种优化图像和视频呈现效果的技术。其原理是在成像时,借助特殊算法与硬件设计,采用多次曝光或多通道采集手段。比如,对同一场景按不同曝光参数多次采集图像,有的针对亮部精准曝光,有的聚焦暗部获取细节,之后把这些图像进行融合处理。这样一来,合成后的图像或视频就能兼顾亮部与暗部的清晰呈现,避免亮部过曝成白、暗部欠曝变黑的问题。在安防监控等领域,部分设备会实时运用算法处理不同曝光数据,以实现持续的宽动态效果。

VGA

视频图形阵列(Video Graphics Array),是 IBM 在 1987 年推出的一种视频传输标准,曾是个人计算机中最常见的显示接口标准,在计算机显示领域有重要地位。常见分辨率为 640×480 像素,它能在显示器上显示相对清晰的图像。VGA 过去广泛应用于电脑显示器、投影仪等设备,用于连接计算机显卡和显示设备传输图像信号。随着技术发展,高清数字接口如 HDMI、Display - Port 等兴起,VGA 因传输带宽有限、不支持高清等缺点逐渐被取代,但在一些老旧设备或特定场合仍有使用。

QVGA

QVGA(Quarter - Video Graphics Array):即四分之一视频图形阵列,分辨率为 320×240 像素。它常用于早期的移动设备,如一些旧款手机、PDA(个人数字助理)等的屏幕显示或摄像头拍摄分辨率,因这些设备的屏幕尺寸较小、处理能力有限,QVGA 分辨率既能满足基本显示需求,又不会占用过多资源。

CIF

CIF(Common Intermediate Format):即通用中间格式,分辨率是 352×288 像素。在视频通信、监控等领域应用广泛,如早期的视频会议系统、一些安防监控摄像头会采用该分辨率,它在保证一定图像质量的同时,数据量相对较小,便于传输和存储。

SCCB

SCCB(Serial Camera Control Bus)即串行摄像机控制总线,是一种用于图像传感器等设备的串行通信接口。SCCb 采用两线制,即串行时钟线(SCCB - SCL)和串行数据线(SCCB - SDA),与 I²C(Inter - Integrated Circuit)总线协议类似。主设备(如微处理器)通过 SCCB 接口向从设备(如图像传感器)发送控制命令和数据,实现对图像传感器的参数配置,如曝光时间、增益、白平衡等设置。

AEC

AEC(Auto - Exposure Control,自动曝光控制):这是一种用于图像传感器等设备中的技术。在拍摄过程中,它能够根据环境光线的变化自动调整曝光参数,例如曝光时间、增益等。比如在光线较暗的环境中自动延长曝光时间,在光线充足时缩短曝光时间,以确保拍摄出的图像具有合适的亮度和对比度,避免出现过亮或过暗的情况。

AGC

AGC(Auto - Gain Control,自动增益控制):主要作用是自动调节信号的增益。在图像传感器中,当输入的光信号强度变化时,AGC 会自动调整放大倍数。若光信号较弱,增加增益来放大信号,使图像更清晰可见;若光信号较强,则降低增益,防止信号过载失真,从而保证输出信号的稳定性和可靠性。

AWB

AWB(Auto - White Balance,自动白平衡):这是图像和视频处理中的一项重要功能。不同的光源(如日光、荧光灯、白炽灯等)具有不同的色温,会导致拍摄的画面出现偏色。自动白平衡功能能够自动检测光源的色温,并对图像的色彩进行校正,使得白色物体在不同光源下都能呈现出真正的白色,从而让整个画面的色彩更加自然、准确。例如,在室内白炽灯下拍摄时,画面原本可能会偏黄,AWB 会自动调整色彩,减少黄色调,使色彩还原正常。

ABLC

ABLC(Auto - Black Level Calibration,自动黑电平校准) :图像传感器在没有光线输入时,输出的信号电平理论上应为零,但实际上由于噪声等因素,这个电平并不准确为零。ABLC 技术通过自动测量和调整图像传感器的黑电平,使其准确对应零光输入状态,确保图像的暗部能够正确显示为黑色,增强图像的对比度和层次感,提升图像整体质量。

DPC

缺陷像素校正(defect pixel correction):图像传感器中的像素可能由于制造缺陷、老化或其他原因出现故障,导致在拍摄的图像中出现亮点(白色像素)、暗点(黑色像素)等异常像素。缺陷像素校正技术通过算法检测这些异常像素,并根据周围正常像素的值对其进行修正。例如,对于一个坏点,算法可能会取其相邻像素的平均值来替代该坏点的值,从而使图像看起来更正常,提升整体图像质量。

LSC

镜头阴影校正(lens shading correction):由于镜头的光学特性,拍摄的图像可能会出现边缘比中心暗的情况,这种现象称为镜头阴影或渐晕。镜头阴影校正技术通过分析图像的亮度分布,对图像不同区域的亮度进行调整。通常会建立一个校正模型,根据图像中每个像素的位置来确定其需要补偿的亮度值,对边缘区域进行适当的提亮,使得整幅图像的亮度更加均匀,避免边缘过暗而丢失细节。

BLC

黑电平校准(black level calibration):黑电平是指图像传感器在没有光线输入时输出的信号电平。在实际拍摄中,由于传感器的噪声等因素,黑电平可能并不准确为零,这会导致图像的暗部出现偏灰或不准确的情况。黑电平校准技术通过测量和调整图像传感器的黑电平,使其准确对应于零光输入的状态。这样可以确保图像的暗部能够正确地显示为黑色,增强图像的对比度和层次感,使图像的整体质量得到提升。

DDR

“Double Data Rate”,即双倍数据速率。DDR 是一种用于高速数据传输的技术,主要应用于内存和一些高速数据接口等领域,在 CMOS 图像传感器芯片中也有应用。与传统的数据传输方式相比,DDR 能够在时钟信号的上升沿和下降沿都进行数据传输,而不是像普通的单数据速率(SDR)那样只在时钟信号的上升沿传输数据,因此在相同的时钟频率下,DDR 可以实现双倍的数据传输速率,大大提高了数据传输的效率。DDR 技术有多个发展版本,如 DDR1、DDR2、DDR3、DDR4 和 DDR5 等,每个版本在数据传输速率、功耗、信号完整性等方面都有不同的特点和改进。

H.BLK/V.BLK

- H.BLK:水平消隐信号,在水平方向上,用于表示一行像素数据传输结束到下一行开始之间的间隔,期间不传输有效图像数据

- V.BLK:垂直消隐信号,在垂直方向上,用于表示一帧像素数据传输结束到下一帧开始之间的间隔,期间不传输有效图像数

H.OB/V.OB

分别表示水平和垂直方向的重叠区域(Overlap Region),与有效像素区域相关联

同步码

- SAV:Start of Active Video,有效视频起始标志,分为有效行和无效行的 SAV,用于标识不同状态下有效视频的起始位置

- EAV:End of Active Video,有效视频结束标志,分为有效行和无效行的 EAV